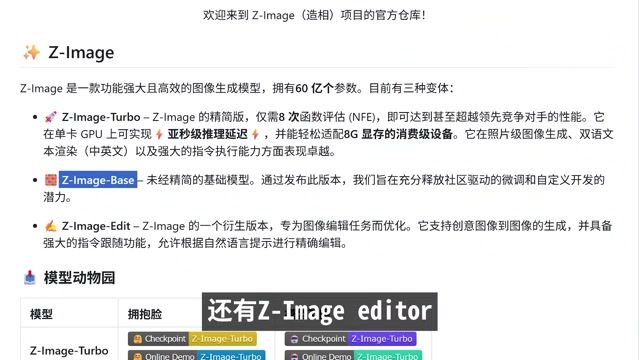

Z-Image 是一款拥有 60 亿参数的高效开源文生图模型,主打精准的中文语义理解与零内容审查。对硬件极其友好,8G 显存即可入门,支持 Windows (NVIDIA) 与 Mac (M 芯片) 本地部署。TAGVPN 团队完成了完整的部署实测——特别提醒:模型托管在 GitHub/HuggingFace,下载过程中必须使用 TAGVPN 等全局代理工具,否则会导致安装失败。

硬件与性能速查

| 指标 | 数值 | 备注 |

|---|---|---|

| 参数规模 | 60 亿 (6B) | 兼顾美学品质与运行效率 |

| 最低显存 | 8GB VRAM | 可运行,速度受限 |

| 推荐显存 | 12-24GB VRAM | 24G 下数秒出图 |

| 模型变体 | Tonable / Base / Elite | 不同细分场景 |

| 软件环境 | Python 3.10/3.11 + Git | 必须预装 |

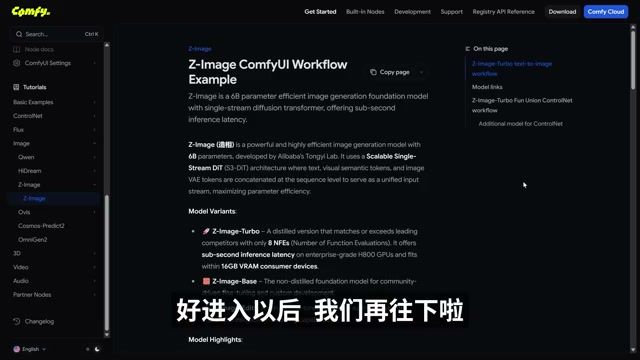

| 客户端 | ComfyUI | 可视化工作流工具 |

| 模型文件 | 约 10GB+ | 含工作流与核心权重 |

硬件兼容性

- Windows — 必须 NVIDIA 显卡(CUDA 加速),RTX 3060/4060 及以上

- Mac — 必须 M1/M2/M3/M4 芯片,旧款 Intel Mac 不支持

- Linux — 支持 NVIDIA CUDA 环境

模型评测排名

在人类偏好评估基准中,Z-Image 与 Midjourney、DALL-E 3 等商业模型的对比表现:

作为开源免费模型,Z-Image 在多个维度上达到了与商业模型相当的水平,性价比极高。

部署步骤一:安装基础环境

开始之前,确保已安装以下基础工具:

- Python 3.10 或 3.11 — 从 python.org 下载,安装时勾选”Add to PATH”

- Git — 从 git-scm.com 下载安装

- TAGVPN 全局代理 — 后续下载模型和依赖包必须通过代理访问 GitHub/HuggingFace

重要:模型文件和 PyTorch 依赖包总计约 13GB,下载速度直接取决于你的代理质量。建议使用 TAGVPN 的低延迟线路。

部署步骤二:安装 ComfyUI 并配置中文

ComfyUI 是推荐的可视化工作流客户端,支持一键切换中英文界面。

安装过程中,系统会自动检测显卡驱动并安装对应的 PyTorch 环境(约 3GB)。这一步下载较慢,保持 TAGVPN 连接稳定即可。

部署步骤三:导入工作流

下载 Z-Image 官方工作流文件并导入 ComfyUI,可以看到完整的节点图界面。

工作流支持自定义配置:

- 分辨率 — 支持 512x512 到 1920x1080 等任意比例

- 种子值 (Seed) — 固定种子可复现相同画面,方便风格迭代

- 采样步数 — 步数越高细节越丰富,但耗时增加

出图效果实测

Z-Image 对中文的语义理解能力令人惊艳。输入”登鹳雀楼”的诗句,模型能精准还原意境而非简单翻译关键词。

在高配 NVIDIA 显卡上,生成速度接近实时。24GB 显存下单张图片仅需数秒。

无法本地部署?试试在线平台

如果你的硬件配置不足以本地运行,Z-Image 也提供免费的在线共享 GPU 平台,无需任何安装即可体验。

在线平台同样需要稳定的网络连接,使用 TAGVPN 可确保流畅访问和快速的图片加载。

注意事项与避坑指南

| 问题 | 解决方案 |

|---|---|

| 模型下载失败/超时 | 开启 TAGVPN 全局代理模式 |

| Python/Git 安装报错 | 确认已勾选”Add to PATH”选项 |

| 显存不足 (OOM) | 降低分辨率或切换 Tonable 变体 |

| ComfyUI 启动失败 | 检查 PyTorch 是否匹配显卡驱动版本 |

| 生成结果模糊 | 提高采样步数至 30-50 步 |

适用人群

- 隐私创作者 — 不希望作品上传云端,所有数据本地处理

- 中文语境画师 — 追求精准中文理解,告别蹩脚英文提示词

- 中端配置玩家 — RTX 3060/4060 等 8-12G 显存即可流畅使用

不建议以下用户使用:Intel Mac 用户(硬件不兼容)、移动端用户(仅支持桌面端)。

网络环境总结

本地部署 AI 模型的全流程中,有多个环节依赖海外网络资源:

- GitHub 克隆仓库 — 需代理

- HuggingFace 下载模型权重 — 需代理,文件 10GB+

- PyTorch/pip 依赖安装 — 部分包托管在海外 CDN

- 在线平台访问 — 免费 GPU 平台多为海外服务

TAGVPN 的全局代理模式可一次性解决上述所有网络问题。250+ 高速线路确保大文件下载不断连,让你专注于创作而非折腾网络。

延伸阅读

- Nano Blana 2 深度实测:Google 全球第一的 AI 生图模型 — 云端生图方案对比

- Seedance 2.0 深度评测:AI 视频生成工具 — 图生视频的进阶玩法

- Claude Code 六层记忆系统深度解析 — 用 AI 辅助本地开发部署

- 2026 AI 付费指南 — 云端 vs 本地的成本对比

模型下载加速:下载 TAGVPN 客户端 | 查看套餐

关于作者